Nvidia anuncia optimizaciones en todas sus plataformas para acelerar Meta Llama 3, la última generación del gran modelo de lenguaje (LLM). El modelo abierto combinado con la computación acelerada por Nvidia equipa a desarrolladores, investigadores y empresas para innovar de forma responsable en una amplia variedad de aplicaciones.

Entrenado en Nvidia AI

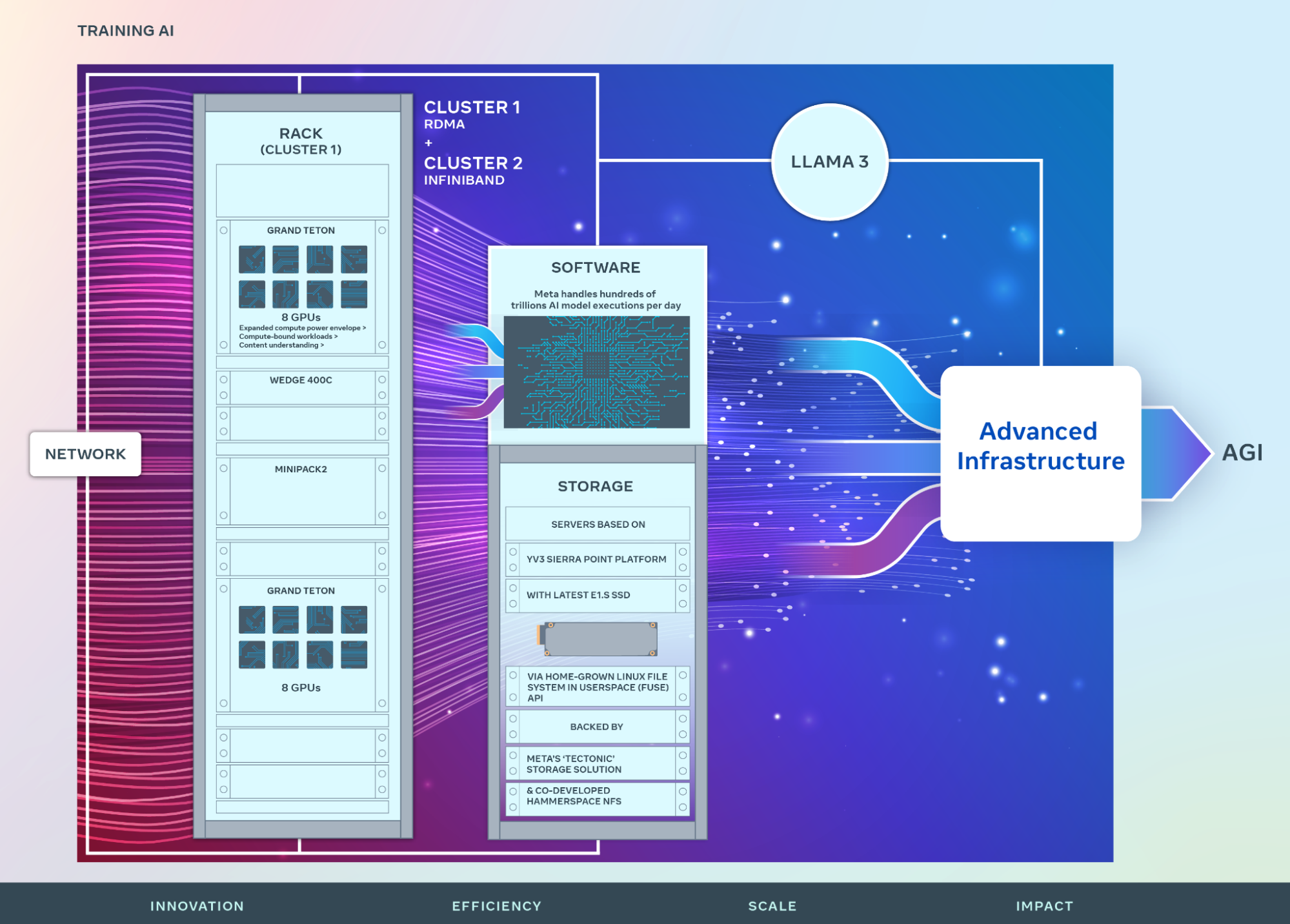

no posts foundLos ingenieros de Meta entrenaron Llama 3 en clusters de computación con 24.576 GPUs Nvidia H100 Tensor Core, conectadas con redes RoCE y Nvidia Quantum-2 InfiniBand. Con el apoyo de Nvidia, Meta ha perfeccionado sus arquitecturas de red, software y modelos para su vanguardista LLM.

Para seguir avanzando en el estado del arte de la IA generativa, Meta ha descrito recientemente sus planes de ampliar su infraestructura a 350.000 GPU H100.

Puesta en funcionamiento de Llama 3

Las versiones de Llama 3, aceleradas en las GPU Nvidia, están disponibles para su uso en la nube, el centro de datos, el perímetro y el PC. Desde un navegador, los desarrolladores pueden probar Llama 3 en ai. nvidia. Está empaquetado como un microservicio Nvidia NIM con una interfaz de programación de aplicaciones estándar que puede implantarse en cualquier lugar.

«Estamos encantados de ofrecer más de esta tecnología de IA de Nvidia para impulsar la innovación. Con Meta Llama 3 optimizada para nuestras GPU, estamos permitiendo a desarrolladores y empresas explorar todo el potencial de la inteligencia artificial en una gran variedad de aplicaciones, desde la nube hasta los dispositivos de borde», afirma Marcio Aguiar, director de la división Enterprise de Nvidia para Latinoamérica.

Las empresas pueden ajustar Llama 3 con sus datos utilizando Nvidia NeMo, un marco de código abierto para LLM que forma parte de la plataforma segura y compatible Nvidia AI Enterprise. Los modelos personalizados pueden optimizarse para la inferencia con TensorRT-LLM de Nvidia e implantarse con el servidor de inferencia Triton de Nvidia.

Llevando Llama 3 a dispositivos y PCs

Llama 3 también se ejecuta en Nvidia Jetson Orin para dispositivos de robótica y edge computing, lo que permite crear agentes interactivos como los del Jetson AI Lab.

Además, las GPU Nvidia RTX y GeForce RTX para estaciones de trabajo y PC aceleran la inferencia en Llama 3. Estos sistemas ofrecen a los desarrolladores un objetivo de más de 100 millones de sistemas acelerados por NVIDIA en todo el mundo.

Obtenga un rendimiento óptimo con Llama 3

Las mejores prácticas a la hora de desplegar un LLM para un chatbot implican equilibrar una baja latencia, una buena velocidad de lectura y una utilización óptima de la GPU para reducir costes.

Un servicio de este tipo necesita entregar tokens -el equivalente aproximado a palabras para un LLM- a una velocidad de lectura aproximadamente dos veces superior a la de un usuario, que es de unos 10 tokens/segundo.

Aplicando estas métricas, una sola GPU Nvidia H200 Tensor Core generó alrededor de 3.000 tokens/segundo – suficiente para atender a unos 300 usuarios simultáneos – en una prueba inicial utilizando la versión de Llama 3 con 70.000 millones de parámetros.

Esto significa que un único servidor HGX de Nvidia con ocho GPU H200 podría proporcionar 24.000 tokens/segundo, lo que optimizaría aún más los costes al dar servicio a más de 2.400 usuarios al mismo tiempo.

En el caso de los dispositivos de borde, la versión de Llama 3 con ocho mil millones de parámetros generó hasta 40 tokens/segundo en la Jetson AGX Orin y 15 tokens/segundo en la Jetson Orin Nano.

Avanzando en los modelos de comunidad

Nvidia, que contribuye activamente al código abierto, está comprometida con la optimización del software comunitario que ayuda a los usuarios a afrontar sus retos más difíciles. Los modelos de código abierto también promueven la transparencia en la IA y permiten a los usuarios compartir ampliamente el trabajo sobre seguridad y resiliencia de la IA.

Obtenga más información sobre la plataforma de inferencia de IA de Nvidia, incluida la forma en que NIM, TensorRT-LLM y Triton utilizan técnicas de vanguardia como la adaptación de bajo rango para acelerar los últimos LLM.